OpenAI arrive au catalogue Azure : les choses à savoir

Disponibilité globale actée pour Azure OpenAI Service. En quoi cette offre se différencie-t-elle de l'API ?

L'heure de la maturité pour Azure OpenAI Service ? Microsoft vient en tout cas d'en annoncer la disponibilité globale.

Le cloud du groupe américain héberge déjà les modèles que permet d'exploiter l'API OpenAI. Avec cette offre, il y donne également accès... mais avec des fonctionnalités et des garanties supplémentaires. Par exemple :

- Le chiffrement des données au repos, comme pour l'ensemble de la gamme de « service cognitifs » dans laquelle s'inscrit l'offre ; et la possibilité, pour le client, d'utiliser ses propres clés (avec Azure Key Vault)

- Une connexion à la bibliothèque SynapseML pour pouvoir exploiter Spark sur de gros jeux de données

- Un hébergement dans la région Europe de l'Ouest pour l'essentiel des modèles disponibles

- Des identités managées avec Azure Active Directory

- Un système de modération différent de celui d'OpenAI

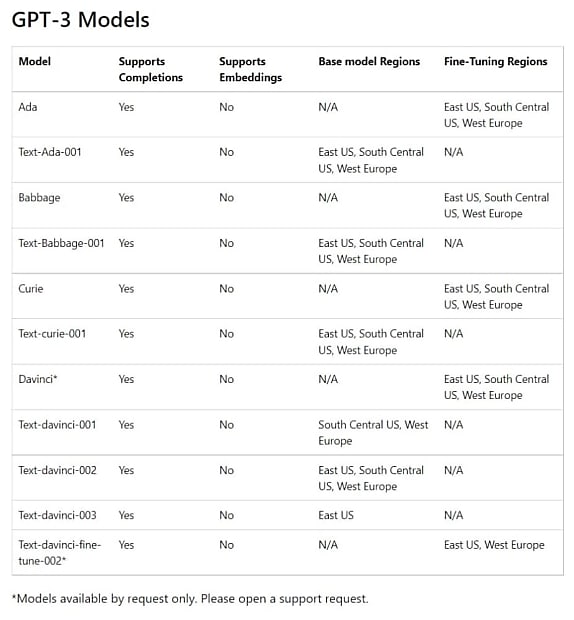

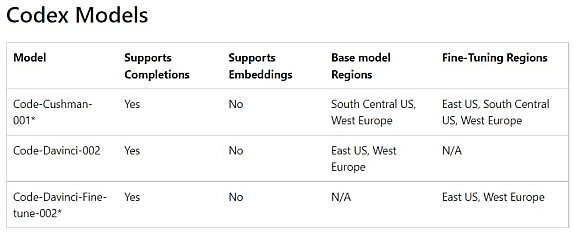

GPT-3, Codex... Les modèles disponibles

La version commerciale d'Azure OpenAI Service englobe deux familles de modèles : GPT-3 et Codex - l'API DALL-E restant à l'état expérimental.

La catégorie GPT-3 regroupe six modèles « prêts à l'emploi » et cinq « prêts à entraîner » (dont un sur demande). La catégorie Codex en contient deux de chaque type.

Le catalogue comprend aussi la première génération des modèles d'embedding fondés sur GPT-3. Tous sont disponibles dans la région Azure Europe de l'Ouest. Ces modèles peuvent créer des représentations vectorielles de chaînes caractères, qu'on peut ensuite exploiter pour évaluer la proximité entre ces chaînes. Par exemple dans le cadre de moteurs de recherche, de systèmes de recommandation ou d'outils de détection d'anomalies.

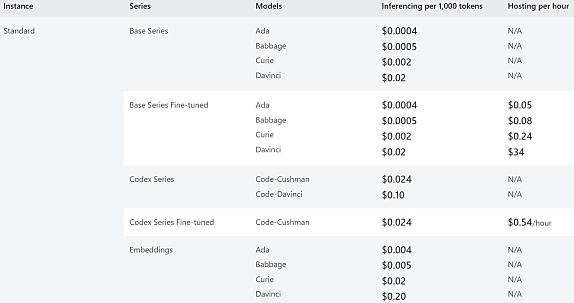

Des prix plus intéressants que l'API OpenAI ?

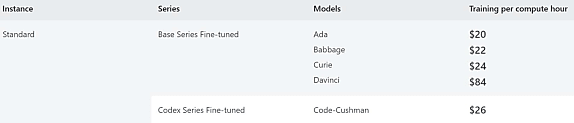

Pour les modèles de base, la tarification est la même qu'à travers l'API OpenAI. Pour les modèles qu'on a soi-même entraînés, le coût des requêtes est un peu plus bas, mais il faut ajouter des frais d'hébergement, facturés à l'heure.

En entraînement, les tarifs sont les suivants :

L'écosystème Azure mis à contribution

Comme pour les autres services Azure, avant de déployer un modèle, il faut créer une ressource ou une instance du service. Des limites s'appliquent. Entre autres :

- Pas plus de deux ressources OpenAI par région Azure

- Maximum 15 requêtes/seconde par déploiement

- File d'attente en entraînement limitée à 20 tâches

- Durée maximale d'une tâche d'entraînement : 120 heures

Microsoft lève progressivement certaines de ces limites. Dernièrement, il a enrichi l'API en intégrant, dans les réponses, des informations sur le coût des requêtes. Tout en établissant un lien avec ses modules Azure Resource Health et Cost Analysis pour la journalisation.

La présentation d'Azure OpenAI Service remonte à fin 2021. Parmi ceux qui l'ont expérimenté depuis :

- Al Jazeera Digital, pour le traitement de l'information sur ses chaînes

Capacités exploitées : résumé de texte, traduction, étiquetage et extraction de contenu

- CarMax (concessionnaire d'occasion américain) pour synthétiser les évaluations de ses clients et aider à comparer les modèles d'un véhicule

- KPMG pour accompagner les initiatives de transparence fiscale

- Moveworks (start-up américaine) pour automatiser l'enrichissement des bases de connaissances de ses clients

Du côté de Microsoft, on a notamment intégré des morceaux de GPT-3 dans Power Apps, pour aider à générer des formules et des expressions. On propose aussi, à partir de DALL-E, l'application Microsoft Designer.

Illustration principale générée par IA

Sur le même thème

Voir tous les articles Data & IA