Code Llama : un modèle spécial Python au menu de Meta

Meta vient d'ouvrir l'accès à Code Llama, Comment se présente cette famille de LLM destinée à assister les développeurs ?

Qui peut le plus peut le moins ? Dans l'univers des LLM, pas forcément. Les équipes de Meta AI l'ont constaté lors du développement de Code Llama.

Il aura fallu 400 000 heures GPU (sur des A100-80) pour entraîner les trois types de modèles qui composent cette famille. En l'occurrence :

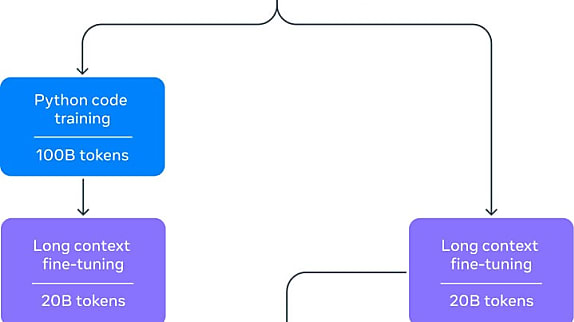

> Code Llama, le plus « générique », conçu pour la synthèse et l'interprétation de code. Il se fonde sur le modèle Llama 2, affiné avec un dataset de code puis entraîné sur une grande fenêtre de contexte (jusqu'à 16 384 tokens).

> Code Llama - Python, auquel on a appliqué le même traitement, en y ajoutant un entraînement spécifique sur ce langage.

> Code Llama - Instruct, adapté quant à lui au traitement d'instructions en langage naturel.

Lire aussi : Ce que Llama 3 dit de l'évolution des LLM

Chacun se décline en trois versions, à 7, 13 et 34 milliards de paramètres. Certaines - auxquelles on a accolé des doubles flèches sur le schéma ci-dessous - ont, en complément, bénéficié d'un entraînement de type FIM (fill-in-the-middle = insertion de code).

Une fenêtre de contexte grande ouverte

Les modèles sont sous la même licence « maison » que Llama 2. Celle-ci autorise l'usage commercial, mais il faut remplir un formulaire pour télécharger les poids.

Les versions à 7 milliards de paramètres peuvent tourner sur un seul GPU, nous affirme-t-on.

Dans le domaine des « IA qui codent », le nombre de paramètres a une incidence importante sur les performances, note Meta, benchmarks à l'appui.

L'élargissement de la fenêtre de contexte permet quant à lui d'envisager de travailler à l'échelle d'un dépôt plutôt que d'un simple fichier. Meta considère que ses modèles peuvent monter jusqu'à 100 000 tokens. Mais reconnaît aussi que cet élargissement a tendance à les rendre moins performants quand la fenêtre n'est pas pleinement exploitée (prompts de moins de 4000 tokens en particulier)...

Illustration principale © maciek905 - Adobe Stock

Sur le même thème

Voir tous les articles Data & IA

![Déployer l'IA à l'échelle : l'approche d'AXA, entre vision et [...]](https://cdn.edi-static.fr/image/upload/c_lfill,h_201,w_298/e_unsharp_mask:100,q_auto/f_auto/v1/Img/BREVE/2025/4/473364/deployer-echelle-approche-axa-L.jpg)